面接でAIを使うのはズルなのか?答えは思っているより複雑です

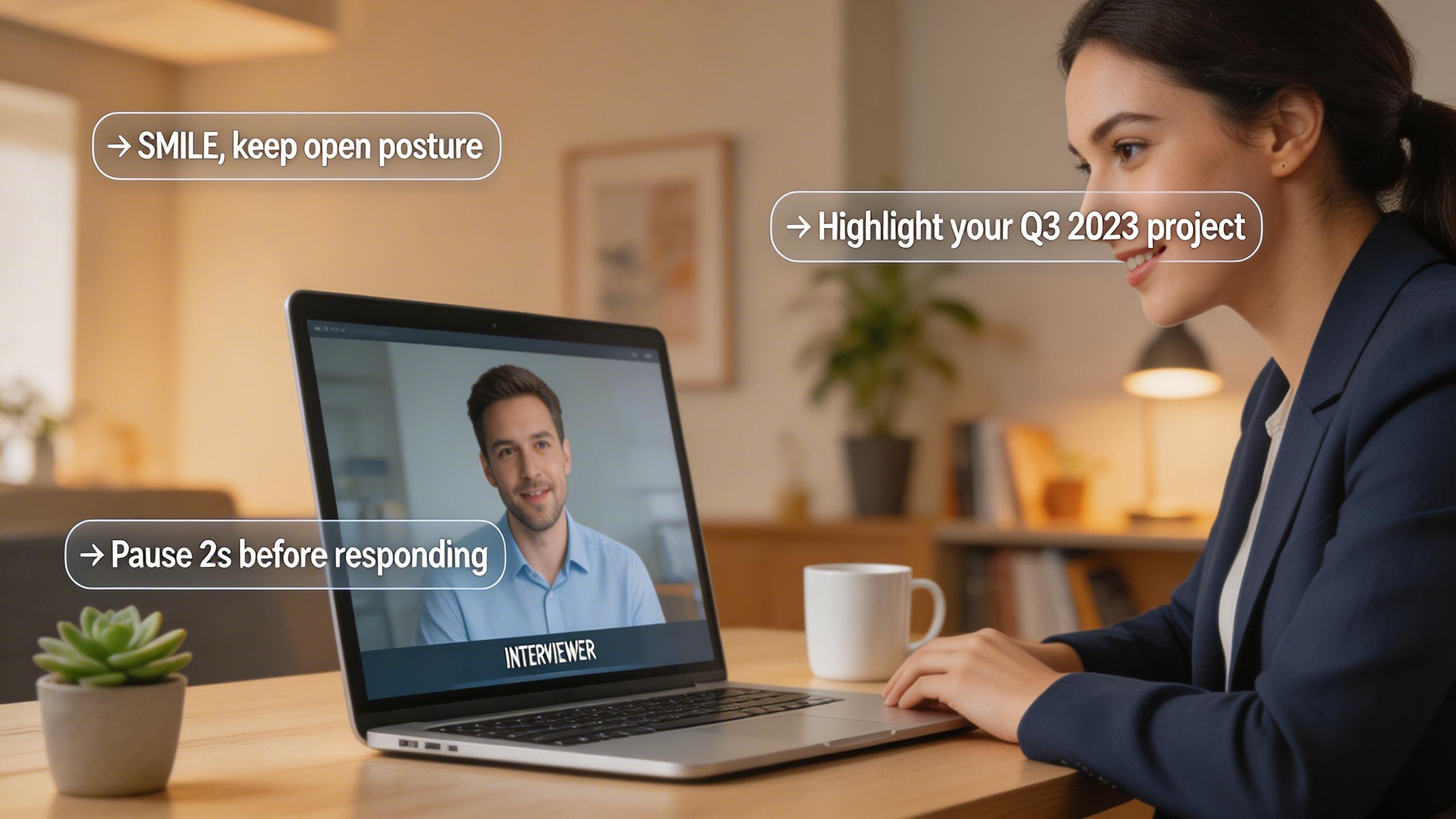

まとめ: 面接の準備にAIを使うことはカンニングではありません——賢い練習です。一方、面接中にAIに答えを生成させ、自分の考えとして話すことは欺瞞です。問題はツールではなく、本物の能力を示しているのか、持っていない能力を偽っているのかという点にあります。このガイドでは、その線引きの正確な位置、採用担当者が実際に何を検知できるのか、そしてAIを使って一時的に「うまく聞こえる」だけでなく本当に成長する方法を解説します。

2025年初頭、あるスタートアップの創業者がZoomの選考中に奇妙なことに気づきました。候補者の回答が不自然なほど洗練されており、話すペースもどこかぎこちない。そして彼はあるものを見てしまいました——眼鏡に反射するテキストです。候補者はAIが生成した回答をリアルタイムで読んでいたのです。

その話はすぐに広まりました。次に来たのは、Amazonのインターン内定を得た学生が、面接プロセス全体を通じてAIオーバーレイツールを使っていたとSNSで自慢し、内定取り消しになったというニュースです。CodeSignalのデータでは、技術評価でのカンニングが1年で2倍——16%から35%——に増加したことが示されています。

現在、米国の就業者の5人に1人が、ライブ面接中に密かにAIを使ったと認めています(Blind, 2025)。半数以上が「当たり前になっている」と言います。

では:面接でAIを使うことはカンニングなのか?そして、実際にどうすべきなのか?

本当の問いは「AIは許可されているか?」ではなく「自分を正しく表現しているか?」

面接におけるAIの倫理的な問いはすべて、一点に集約されます:自分の能力を示しているのか、持っていない能力を偽っているのか?

この区別はシンプルに聞こえます。しかし実際には、すぐに複雑になります。

面接前に企業をリサーチするためにAIを使うこと——明らかに問題なし。模擬練習セッションでAIにSTAR形式の回答を作ってもらい、それを自分のものとして内面化・個人化すること——問題なし。行動面接の回答構造を本当に理解できるまで50問を練習すること——問題なし。

面接中にAIにリアルタイムで回答を生成させ、面接官が「これは候補者自身の言葉だ」と思いながら聞いているところで読み上げること——これが問題です。「AIが悪い」のではなく、自分が何者であるかを偽っているからです。

Fabric HQ「2026 State of AI Interview Cheating」レポート(19,368件の面接を分析)によると、全候補者の38.5%がカンニング行動のシグナルを示していました。技術職では48%に達しています。そして重要なのは:フラグが立てられた不正者の61%が、AI検出ツールなしの標準的な採用プロセスを通過してしまうという事実です。採用される。その後はどうなるのか?

Amazonのインターンの話は示唆に富んでいます。彼は初日にGitを使えませんでした。面接は持っていない能力を偽った結果でした。それはキャリアの勝利ではなく、罠です。

就活でも転職でも、長い目で見れば正直な準備こそが身を守ります。日本社会において「恥」——不正がバレたときの社会的代償——は決して小さくありません。

2026年の「AI面接カンニング」とは実際何を意味するのか

どこに立つかを決める前に、スペクトル全体を理解することが助けになります。

オーバーレイツール(最も明確なカンニング): CluleyやLockedIn AIなどのアプリは、画面上に見えない形で動作し、面接官の音声を音声認識でキャプチャし、候補者が読める形で生成した回答を表示します。面接官にはまったく見えません。本質的には、他の誰かに面接を受けさせているのと同じです。Cluleyの創業者はAmazonのインターンシップをこの方法で得た動画をバズらせ、「これはカンニングでさえない、LeetCodeのテストは無意味だ」とフレームしました。LeetCodeへの批判が一部正当だとしても、「テストが悪い」という主張は、それを偽造することを倫理的にしてくれません。

ディープフェイクなりすまし(最も極端な例): Gartnerは、2028年までに世界中の候補者プロフィールの4分の1が完全に偽物——合成音声、ディープフェイク動画、生成された資格証明書——になると予測しています。これは仮説ではなく、リモート面接でのなりすましはすでに記録されており、CiscoとGreenhouseが本人確認会社Clearと提携するほどになっています。

ブラウザタブでのリアルタイムChatGPT(グレーゾーン): 面接官の質問をChatGPTに入力して答えを読むことは、機能的にはオーバーレイツールと同じです。ただし候補者は「自分が何を言うか決めている」と合理化します。これもやはり偽造です。

テイクホーム課題でのAI支援メモ参照: 多くの企業は、テイクホーム技術課題でメモやインターネットアクセスを明示的に許可しています。そこでAIを使うことは、ルールによっては明示的に許可されている場合もあります——必ずルールを確認してください。

準備のためのAI: 練習問題の生成、下書き回答へのフィードバック、AIとの模擬面接の実施——これはどんな合理的な基準からもカンニングではありません。コーチを雇うのと同等です。

採用担当者はAIを使ったカンニングを実際に検知できるのか?

部分的には。正直なところを説明します。

検出ツールができること: Sherlock AIやInterviewGuardのような行動分析ツールは、視線追跡パターン、マウスの動きの異常、クリップボードの操作を使って不審な行動にフラグを立てます。HackerRankやCodeSignalは、キーストロークのダイナミクスとコピー&ペーストのイベントを通じて、貼り付けられたソリューションを検出します。一部のビデオ面接プラットフォームは応答レイテンシを分析します——LLMの応答生成とまったく同じ長さの間は不審です。

信頼性を持って検出できないこと: 洗練された言語そのものは検出できません。Wiley/IJSA査読済み研究「ChatGPT, can you take my job interview?」(Canagasuriam et al., 2025)が興味深い発見をしています:面接官はAI生成の回答に何か違和感を感じ取ることができ、誠実さの評価は下がりました——しかしデリバリーのスコアに差はありませんでした。標準的なルーブリックはカンニングを見逃したのです。つまり、面接官が疑っても、ルーブリックだけでは証明できません;ただ別の候補者を先に進めるだけです。

本当の検出器は行動的なフォローアップ質問です: GoogleやCiscoやマッキンゼーが最終面接を対面に戻しつつある理由の一つがこれです。さらに重要なのは、面接官が質問を適応させていることです:「あなたが実際に本番環境にデプロイしたモデルを、深夜2時にデバッグしたインシデントも含めて説明してください」や「その答えで分散合意に触れていましたが、あなた自身が実際に経験した障害モードをホワイトボードで説明できますか?」といった具合です。フォローアップが具体的になれば、本物の経験は偽造しにくくなります。

これが、AI不正行為がスクリーニングレベルで「成功」しても裏目に出る理由です。スクリーニングを通過する。技術的なデブリーフで失敗する。あるいはもっと悪いことに:採用されて仕事ができないことが判明する。

日本の場合、リクルートやメルカリのような企業は面接後の評判ネットワークが密接につながっており、業界内での信用失墜は取り返しがつきません。

採用企業の矛盾(そしてそれが倫理を解決しない理由)

ここには正当な不満があり、率直に認める必要があります:エンジニアにAIの活用を義務付け、採用パイプライン自体にAIを統合し、AI製品から収益を得ている企業が、候補者がコーディングスクリーニングで45分間AIを使ったことを理由に失格にする場合があるのです。

MetaはAIコーディングアシスタントを面接中に使用できるようになりました。AmazonはAIユーザーを失格にします。GoogleはAIを採用に禁止しながら、すべての製品へのAI統合に資金を投じています。Cursor——AIネイティブのコードエディター企業——は自社の採用プロセスでAIを明示的に禁止しています。

これは矛盾しています。「仕事では毎日AIを使うのに、コーディング能力を証明するためにはAIを使えない」という緊張関係は現実であり、Redditのスレッドに溢れる不満には正当な理由があります。

しかし、ここが重要です:その不満がいかに正当であっても、倫理的な計算式は変わりません。問題は面接プロセスが完璧かどうかではなく、虚偽表示に基づいてプロとしての関係をスタートさせたいかどうかです。システムに欠陥があるからといって、偽造することが長期的な利益になるわけではありません。

壊れたシステムへのより良い対応は、カンニングが不要なほど本当に優秀になることです。

一線を越えずにAI面接準備を活用する方法

倫理的かつ効果的なAI支援準備とは実際にどのようなものでしょうか。

模擬面接練習: ターゲットの職種を理解したAIを使ってフルの面接シミュレーションを実施します。目標は回答を暗記することではなく——パターンを十分に理解して、自然に良い回答を構築できるようになることです。AceRound AIはまさにこのためにデザインされたリアルタイムのAI面接練習を提供しています:ライブ面接中に何も「与えられる」ことなく、構造・関連性・デリバリーのフィードバックが得られます。

STAR回答の構築: 自分の実際の経験をもとに、行動面接質問の最初のSTAR回答の下書きを作るためにAIを使います。その後、大きく編集して——自分のものにして、AIの声を切り取り、自分しか知らない具体的な詳細を加えます。その話を10回練習すれば、本当に自分のものになります。

リサーチと質問予測: AIに職務記述書を分析させ、面接で出そうな質問を生成させます。AIを活用した高速読解で会社を深くリサーチします。他のどの候補者よりも、技術スタック・最近のリリース・戦略的な優先事項を知った状態で面接に臨みます。Sony、Recruit、Mercariのような日本企業を受ける場合は、採用担当者のLinkedIn投稿や日経の報道を読み込むことも有効です。

弱点の特定: AIに回答のストレステストを依頼します——「懐疑的な面接官がここで何に突っ込んでくるか?」。このような対抗的な準備が、回答の穴を面接が見つける前に見つけさせてくれます。

面接後のデブリーフ: 各面接の後にAIを使って、どんな質問が出たか、何がうまく答えられたか、何を失敗したかを分析します。継続的な改善ログを作りましょう。

目標は:面接の場に立つときには、もうAIは不要なほど準備が整っていることです。

「もっとちゃんと準備する」ことが実際に勝つ理由

Wiley研究からの直感に反する発見があります:デリバリーの質は、AI不正で準備した候補者と本当に準備した候補者の間で有意差がありませんでした。しかし、誠実さと真正性の評価には差がありました。

面接官は——なぜかを言語化できないときでも——技術的には正しいが本物の経験の質感が欠けた回答に違和感を覚えます。ペースが微妙におかしい。例が完璧すぎる。自然に躊躇するべきところで躊躇がない。

本物の準備は異なる種類の磨きを生みます:本当に内容を知っているから滑らかに答えられる、実際に経験したから苦労話がある、フォローアップに答えられるのはそれが本物のことについて聞いているからです。

技術スクリーニングでAI不正行動のフラグが立てられた38.5%の候補者は、互いに席を争っています。AIをゴーストライターではなくコーチとして使って本当に準備した候補者には、ますます開けた道があります。

よくある質問

就職面接でAIを使うことはカンニングですか? 面接中にリアルタイムでAIに回答を生成させ、自分のものとして提示することは欺瞞です——どのツールを使うかに関わらず。事前にAIを使って準備することはカンニングではありません——コーチを雇ったり参考書を使ったりするのと同等の、賢い練習です。

企業は面接でAIを使ったことを検知できますか? 部分的には。行動分析ツール、視線追跡、キーストロークのダイナミクス、コピー&ペーストの検出が多くのケースを捕捉します。しかし最も信頼性の高い検出器は人間です:本物の経験がなければ答えられないフォローアップ質問です。AIで補助されたスクリーニングを通過した多くの候補者が、技術的なデブリーフや実際の業務で発覚します。

就職面接の準備にChatGPTを使うことは倫理的ですか? はい。ChatGPTを使って質問を練習したり、回答を洗練したり、会社をリサーチしたり、模擬面接をシミュレートしたりすることは倫理的です。倫理的な問いが適用されるのは、ライブ面接中にAIを使いながら、それを自分の考えとして偽っている場合です。

面接でAIを使ったことがバレたらどうなりますか? 即時失格から内定取り消し(Amazonのインターンのケースのように)、リクルーターや企業からの永久ブラックリスト化まで、さまざまな結果があります。AI不正で内定を得た一部の候補者は、実際の業務でそれができないことが判明し、早期解雇につながります。日本の転職市場では業界の横のつながりが強く、評判へのダメージは長く続く可能性があります。

コーディング面接でAIを使うべきですか? まず特定の企業とプラットフォームの明示的なルールを確認してください——一部はすでに許可しています。明示的に許可されていない場合:使わないでください。代わりに面接前にAIで深く準備してください。AIを使った模擬コーディング練習はスクリーニングが測定しているスキルを培いますが、スクリーニング中にAIが生成した回答を使うと、自分が担えない仕事に就くことになります。

技術面接でAIツールを許可している企業はありますか? 企業によって異なります。MetaはAIコーディングアシスタントの使用を認める方向に移行しています。Amazon、Google、ほとんどの伝統的なFAANG企業はまだ禁止しています。Cursorは明示的に禁止しています。常に特定の企業の現在のポリシーを確認してから、思い込まないようにしてください。

著者・Alex Chen。キャリアコンサルタント、元テック採用担当者。採用側で5年間を過ごした後、候補者を支援する側に転向。教科書的なアドバイスではなく、面接の本当のダイナミクスについて執筆しています。

関連記事

リアルタイムAI面接アシスタントとは何か:仕組みと正しい使い方

リアルタイムAI面接アシスタントの実践ガイド。ライブ面接中の動作原理、正当な活用ケース、そして避けるべき使い方を解説します。就活・転職・外資系英語面接にも対応。

就活AI面接対策2026:ガクチカ・自己PRから外資英語面接まで完全ガイド

就活面接にAIを活用する方法を徹底解説。ガクチカ・自己PRのブラッシュアップから外資系英語面接のリアルタイムAI補助まで、2026年の新常識を紹介します。

HackerRank AI面接完全ガイド:面接官が見ているものと通過するための戦略

HackerRankのAI搭載IDEでは面接官があなたのすべてのプロンプトをリアルタイムで確認できます。正しい使い方と合否を分けるポイントを徹底解説します。